CTO下午茶: 当我们谈论万物互联时,我们在谈论什么?

作者:曹图强 思科全球副总裁、大中华区 CTO

一片嫩叶,汲日月精华,沐春秋雨露,汇山水灵性。一朝脱离大树,便需要经过杀青、揉捻、烘干、渥堆、压制等等一系列脱胎换骨的考验,方百炼成茶。再静静地历经岁月,转化出弥久醇香。最后经沸水冲拂,热烈中,舒展沉浮,一吐芬芳。

“禅茶一味”,越是看似简单的东西,越有无比深刻的内容。茶如此,人如此,企业亦如此。

从最初的 “多协议路由器” 到如今的 “万物互联”,过去 30 多年,思科几乎成了 “互联网” 的同义词。思科的软硬件系统承载着全球 80% 的互联网通信,在进入的每一个领域都成为市场的领导者,创造着一个又一个技术传奇。

大浪淘沙。我始终认为,支持思科成功的根本,源于对 “互联网” 本质的深刻理解,以及对 “万物互联” 这一未来发展方向的把握。这两者相辅相成,如同分别握着 “显微镜” 和 “望远镜” 的两只手。“显微镜” 观战术、现本质:明察秋毫、见微知著;“望远镜” 看战略、指方向:高瞻远瞩、洞察未来。

那么,“互联网” 的本质是什么?“万物互联” 又是什么呢?

用中国人的汉字来回答这个问题,最为精辟易懂。

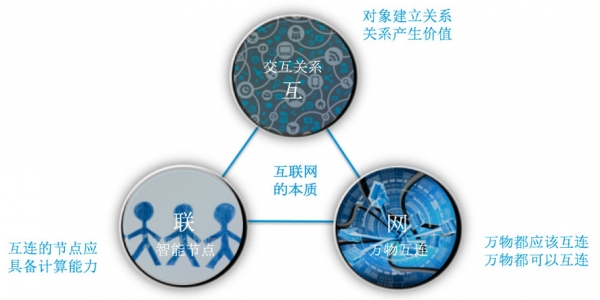

什么是 “互联网”?互联网就是 “网、联、互”。

· “网”:即物理的相互连通,强调的是节点和节点之间的连通,网络就是节点和节点之间的关系的总和;

· “联”:即网络节点是智能节点,要有广义的计算能力,能够处理、存储和发布信息;

· “互”:即交互关系;物理上连通的智能节点之间要在各个层面互动起来。网络建立关系,关系产生价值。

观察思科的成长轨迹,我们可以更直观地理解 “网、联、互”。

· 从创立到今天,思科推出了一系列的路由器、交换机等产品,一直推动着世界的广泛连接——“网”;

· 2009 年起,思科推出了 UCS 和数据中心网络,正式挺进网络计算 ——“联”;

· 32 亿美金收购 WebEx,34 亿美金收购 TANDBERG 等等大手笔,以及对 “云” 的密集部署,都是致力于提高基于网络的交互能力——“互”。

思科不断演进的企业网络、数据中心、协作等产品架构,是“网、联、互”的经典范例。

因此,也可以说,理解了互联网就理解了思科。

如果说过去的思科致力于 “互联网”,现在的思科则致力于 “万物互联”。在思科看来,互联网和物联网(IoT)的未来就是万物互联(Internet of Everything,简称 IoE),就是通过 Internet 连接人、流程、数据以及万物(Networked Connections of People, Process, Data, Things)。

思科倡导的 “万物互联”,几乎成为目前物联网领域出镜率最高的术语了。

同样,用 “网、联、互” 来分析 “万物互联”,又会有怎样的解读呢?

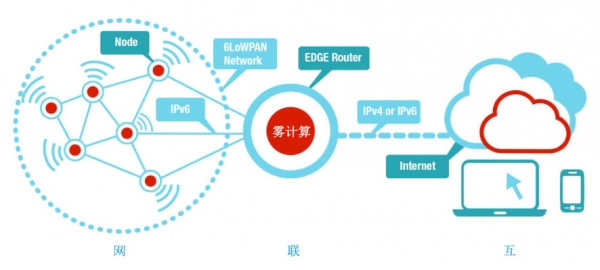

对 IoE/IoT 而言,“网”,这个万物互联的基础,将呈现出更加多样化的格局,新技术、新协议、新方式层出不穷。思科布局低功耗无线技术,6LowPan、LoRA 以及各种工业低功耗无线,正是致力于给 IoE 的应用提供成熟可靠的接入技术和产品。

在“联”的层面上,思科创新性地提出了Fog Computing(雾计算)的概念和架构。未来无论IoE/IoT的智能终端节点的网络拓扑结构如何,这些智能节点都需要通过一个被称为“现场计算”(Field Computing)的网络节点互联到互联网,并进一步联接到云端。这个现场计算的节点,就是雾计算节点。通俗理解的话,可以说 “云在天边,雾在身边”。雾计算在IoE/IoT网络现场,承担着多协议网关以及多业务网关的作用,是物联网中分布式计算和智能的重要组成部分。

最后是 “互”,IoE/IoT 的特点决定了 IoE/IoT 总体架构必定是一个 “云” 架构,“万物” 通过 “雾节点” 接入互联网,并在云端进行丰富的交互。在云端,如此大规模的业务接入,如此频繁快速的业务部署和变化,如此巨量的计算和服务需求,都要求 “云” 本身和“云”网络更加具备 ASAP 特性:Analyze(分析),Simplify(简单),Automate(自动化)和 Protect(保护)。

万物互联,看似复杂实则简单,万物互联就是 “网、联、互”;

万物互联,看似简单实则深刻,万物互联里蕴涵着巨大能量;

未来已来,时不我待。 唯有把握时机,以变应变,以创新促变革。尽管 “路漫漫其修远兮”,我辈将上下求索,永不止步!

万物互联正当时!

思科全球副总裁、大中华区 CTO

好文章,需要你的鼓励

利亚德沙特 LED 视效工厂预计 7 月投产,Micro LED 本地交付进入中东

今天讲的出海案例是利亚德,这家 1995 年成立、从 LED 显示产品研发生产销售起步,并做到小间距和 Micro LED 的视效科技公司,沙特工厂预计 2026 年 7 月投产。

法国Talan研究中心新突破:AI眼睛如何像真正认识世界一样学会辨认新事物?

法国Talan研究中心提出MC-RFM,将少样本视觉识别重构为混合曲率流匹配问题,结合双曲与欧几里得空间优势,在Transformer骨干和精细粒度任务上取得系统性提升。

Locus Robotics收购Nexera Robotics,加速仓储机器人自主拣选能力升级

Locus Robotics宣布收购加拿大温哥华机器人公司Nexera Robotics,将其专有的NeuraGrasp末端执行器技术整合至Locus Array平台。NeuraGrasp融合AI抓取智能、计算机视觉及专利软膜结构,可动态适应不同形状、材质、重量的商品,显著扩大了可自主拣选的SKU类型范围。此次收购将加速Locus Robotics在移动操控领域的技术路线图,推动仓储全流程自动化履约能力迈上新台阶。

ServiceNow研究院打造“语音客服考试官“:当AI给AI打分,谁来保证公平?

ServiceNow研究团队构建的EVA-Bench框架,通过AI对AI的音频通话测试,量化评估语音客服系统在准确性和对话体验两个维度的真实表现,揭示现有系统普遍存在的可靠性缺口。

Locus Robotics收购Nexera Robotics,加速仓储机器人自主拣选能力升级

人形机器人ROI路径渐明,商业化成功关键在于有效产出

OpenBind发布首个AI药物发现模型,推动英国领跑AI制药领域

微软新AI系统发现16个Windows漏洞,含四个高危远程代码执行漏洞

索尼发布十周年纪念款1000X Collexion旗舰耳机,搭载Edge AI技术

索尼WH-1000XM6降噪耳机推出全新砂岩配色

特斯拉将在休斯顿附近建造大型太阳能电池板工厂

Stellantis计划推出起售价低于1.8万美元的平价电动车

LiveWire收购Dust Moto,正式进军电动越野摩托车市场

Romark Logistics携手Dexory,以AI驱动实时库存可视化平台革新仓储管理

Google Workspace全面升级:新增语音、图像编辑与收件箱AI功能

暗光纤基础设施争夺战:Big Fiber获2.5亿美元融资加速AI网络布局