发布“敏捷的NaaS”战略,HPE Aruba Atmosphere 2023北京大会盛大召开

北京 – 2023年6月20日 – HPE Aruba Networking日前召开Atmosphere 2023世界巡演·北京大会,本次大会以“敏捷的NaaS”为主题,吸引了多位技术专家及行业领军人士到场。Aruba中国区总裁谢建国、Aruba亚太区技术销售总监马克·维布鲁特、Aruba中国区技术销售总监俞世丹,以及来自IDC、AMD等合作伙伴的重磅嘉宾围绕Aruba最新的现代化网络技术和产品信息,行业解决方案,成功客户案例进行了精彩的解读和分享。

Aruba中国区总裁 谢建国

发布全新战略方向 锚定“敏捷的NaaS”

NaaS(网络即服务)成为网络未来发展的一大趋势,据IDC预测,到2026年,30%的中国中大型企业将采用NaaS(网络即服务),以实现运营敏捷性、服务定制和灵活的计费模式,来支持复杂的网络和多云环境。本次大会上,HPE Aruba Networking正式发布基于HPE GreenLake的“敏捷的NaaS”战略,将进一步简化核心网络的交付服务。Aruba推出全新的敏捷的NaaS(Agile NaaS)框架,提供网络即服务模型的灵活性,告别传统“一刀切”的网络管理方法,旨在为终端用户及合作伙伴提供更简单易用的按需消费网络服务。

为便于客户获取整套服务,全新的服务包(Service Pack)现已纳入HPE GreenLake for Aruba Networking,合作伙伴可将其为客户提供的设计和交付服务与月度NaaS技术订阅服务合为一体。

推出重量级产品 迈入AI赋能的网络管理时代

基于“敏捷的NaaS”战略,HPE Aruba Networking隆重推出下一代HPE Aruba Networking Central云网络管理平台,该平台进行了全新的优化设计,借助智能运维(AIOps)来减少需要人工参与的操作,能够在实现简化运维并大幅提升效率的同时,让网络团队节省出更多时间,用在更具战略性和高价值的工作中。全新设计的HPE Aruba Networking Central将为企业带来广泛的商业价值,包括工厂自动化运维、优化用户体验、降低碳排放,以及实现全渠道零售业务的线下、线上和移动无缝消费体验。

除了产品发布之外,HPE Aruba Networking同时宣布了两项收购业务以扩大现有的产品组合:一项是收购了提供私有5G网络技术的Athonet,另一项是收购Axis Security提供整合的SASE安全解决方案,两项收购后,HPE Aruba Networking边缘到云的产品实力将得到进一步增强。

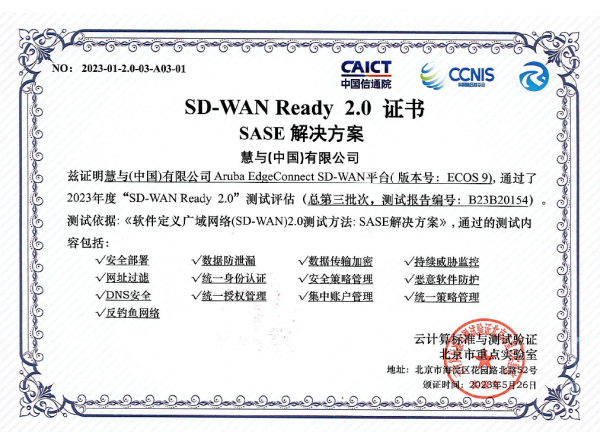

本地化再进一步 喜获SD-WAN Ready 2.0认证

除了全新的战略和产品之外,HPE Aruba Networking在本地SD-WAN领域也取得了重要新突破。近期,Aruba中国参与了由中国信息通信研究院和中国通信标准化协会算网融合产业及标准推进委员会(CCSA TC621)联合发起的“SD-WAN Ready2.0”权威行业评测项目,凭借着一流的SASE、灵活、安全的边缘到云网络基础设施及全面的安全边缘产品组合,Aruba中国获得了SD-WAN Ready 2.0认证。

如今,云网融合、多云协同都离不开SD-WAN,SD-WAN借助多云接入和集成安全的力量,可以帮助企业提高性能、降低成本并保护关键资产,SASE是SD-WAN未来发展的方向,通过深度融合网络连接和网络安全,可有效应对数字化转型所带来的各种安全威胁。HPE Aruba Networking拥有世界领先的SD-WAN技术,连续 5 年获评 Gartner SD-WAN 魔力象限™ 领导者,面向日益增长的SD-WAN市场需求,HPE Aruba Networking不断打磨产品技术,帮助企业简化广域网架构并控制成本,最大化利用网络资源,此次获得认证代表着业界对Aruba专业技术实力的肯定。

Aruba中国区总裁谢建国表示,“数字化转型方兴未艾,网络在其中扮演着越来越重要的角色,企业开始关注能够支持业务敏捷创新,同时又安全可靠的现代化网络基础设施,Aruba始终走在网络世界的前端,紧跟未来数字化转型需求,推出最新NaaS网络即服务战略和创新网络技术产品。未来,Aruba会继续怀抱‘让连接无处不在’的愿景,在网络前沿不断探索,帮助企业打造更好的网络体验,为转型提供强大的驱动力。”

来源:业界供稿

好文章,需要你的鼓励

伊斯法罕大学研究团队揭秘:AI教育应用如何在数字化教学时代赢得用户青睐

伊斯法罕大学研究团队通过分析Google Play商店21款AI教育应用的用户评论,发现作业辅导类应用获得超80%正面评价,而语言学习和管理系统类应用表现较差。用户赞赏AI工具的快速响应和个性化指导,但抱怨收费过高、准确性不稳定等问题。研究建议开发者关注自适应个性化,政策制定者建立相关规范,未来发展方向为混合AI-人类模型。

Google发布Gemini 3 Flash并将其设为默认模型

谷歌发布基于Gemini 3的快速低成本模型Flash,并将其设为Gemini应用和AI搜索的默认模型。新模型在多项基准测试中表现优异,在MMMU-Pro多模态推理测试中得分81.2%超越所有竞品。该模型已向全球用户开放,并通过Vertex AI和API向企业及开发者提供服务。定价为每百万输入token 0.5美元,输出token 3美元,速度比2.5 Pro快三倍且更节省token用量。

伊利诺伊大学香槟分校团队揭秘:如何在数据海洋中精准找到“最对胃口“的训练素材

这项由伊利诺伊大学香槟分校等四所院校联合完成的研究,提出了名为DaSH的层次化数据选择方法。该方法突破了传统数据选择只关注单个样本的局限,通过建模数据的天然层次结构,实现了更智能高效的数据集选择。在两个公开基准测试中,DaSH相比现有方法提升了高达26.2%的准确率,同时大幅减少了所需的探索步数。

英特尔酷睿Ultra第三代,如何推动AI PC规模化落地?

Google发布Gemini 3 Flash并将其设为默认模型

# 思科自研AI模型正式应用于产品,首先赋能身份安全服务

超大规模云厂商在2025年是解决了电力问题还是重新思考了问题?

# 英伟达成为唯一能免费提供AI模型的厂商

Retell AI推出自动化质检系统,解决语音智能体人工审核瓶颈

# 法国生物科技公司发布全球首个生物学通用AI模型

# JEDEC开发减少引脚数的HBM4标准以提升容量

# Ewigbyte光学归档存储技术及战略解析

2025年:可穿戴设备全面转向AI技术

# Oracle领衔科技巨头5000亿美元AI数据中心租赁狂潮

新农人:西云数据如何绘制智慧农牧“全景图”

HPE Aruba Networking推出企业级私有5G网络 简化专用蜂窝网络部署

HPE Aruba Networking:AI与5G创新融合 释放百业新质生产力

HPE Aruba Networking推出全新AI网络安全和可视化产品 高效应对生成式AI安全威胁

化繁为简 Aruba打造AI赋能的安全融合网络

HPE Aruba Networking推出新一代Wi-Fi 7接入点 助力企业高效应对安全、AI与物联网挑战

HPE Aruba Networking推出两项全新产品 满足中小型企业日益增长的网络及安全需求

HPE与英国电信合作推出全球托管局域网服务

发布“敏捷的NaaS”战略,Aruba让网络创新触手可及

发布“敏捷的NaaS”战略,HPE Aruba Atmosphere 2023北京大会盛大召开

HPE(Aruba)连续第十七年获评Gartner 2022年企业级有线和无线局域网基础设施魔力象限领导者