第五届“强网杯”线上赛圆满结束,32强即将诞生

6月13日21时,第五届“强网杯”全国网络安全挑战赛线上赛圆满结束。强网精英鏖战36小时,成为本届“强网杯”系列赛事的精彩开局,尽展新时代网络强国的技术实力与风采。线上赛的实力比拼也得到了场外的广泛关注,共有365363人次在线围观,通过“强网杯”实践平台交流安全技术,提升网络安全意识和防护技能。

这场高水准国家级网络安全赛事吸引了社会各界的共同关注,信息工程大学校长郭云飞,河南省委网信办副主任蔡新民,河南省教育厅二级巡视员徐恒振,河南省通信管理局二级巡视员侯剑涛,郑州市人民政府副秘书长王义民,郑州高新技术产业开发区党工委副书记、管委会主任张红军等有关领导和20余位来自一流网络安全学院建设示范高校专家,以及竞赛组织委员会、评审仲裁委员会专家共同出席大赛开幕仪式,见证第五届“强网杯”盛大启动。

硬核赛题激发强网动能

当前,全球数字化转型进程加速,网络空间也随之面临更加复杂多变的安全挑战,促进安全技术交流、创新技术研发、培养高素质网安人才成为推动产业发展的重要课题。作为中央网信办和河南省人民政府联合指导的国家级网络安全竞赛,“强网杯”持续五届广纳精英,不断创新赛制,提升赛题质量,为选手搭建公平公正的全国性技术切磋平台。

本次线上赛采取在线解题(Jeopardy)模式,赛题场景全面覆盖二进制程序逆向分析、Web应用安全、密码分析、智能终端安全、信息隐藏等网络安全领域的主要知识与技能,同时兼顾赛题难度与实践热点,让选手在酣畅淋漓的比拼中,提高新时代、新技术背景下应对更多未知安全风险威胁的应急处置能力和防御水平。

36小时线上鏖战越巅峰

本届“强网杯”共吸引了来自全国31个省级行政区(港澳台除外)的3156支战队、20207人报名参赛。开赛首日,网安精英们就展开了激烈角逐,仅66分钟,来自暨南大学的Xp0int战队率先解出pop_master题目,斩获全场第一滴血!比赛进行2小时,已有5078名选手完成签到,1035支战队成功得分,4道赛题被攻克。截止当日19点,大赛共放出23道赛题,攻克进度78%,Misc、Reverse类题目均已被成功挑战,剩余5道高难度赛题悬而未决。

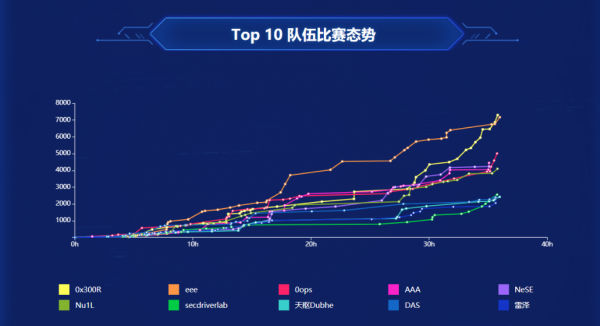

时间分秒流逝,场内战况瞬息万变,在距离比赛结束还有近90分钟时,eee战队与0x300R战队等都展现出网安精英的硬核“战斗力”,上演了一场你追我赶、悬念迭起的冠军争夺战,将竞赛气氛推向高潮。最终0x300R战队成功卫冕本次线上赛第一名,eee战队以微弱的134分差距获得第二名。0ops战队、AAA战队、NeSE战队分别位列第三、四、五名。本次比赛共上线43道高质量赛题,93%被攻克,flag累计提交22589次,第一名的宝座历经14次更迭。

比赛实时战况

Top 10 队伍比赛态势

Top 10 积分总榜

接下来,大赛组委会将结合参赛选手的WriteUp进行最终成绩确认,晋级名单将于近期通过大赛官网及微信公众号正式对外公布。

严正捍卫比赛公平公正

众所周知,公平公正的比赛是训练、选拔真正有用之才的前提与基础,大赛裁判组和组委会对任何破坏比赛公平性行为零容忍。为此,比赛全面部署了专业的反作弊平台,对大赛全程护航。比赛过程中,经过反作弊平台和导调裁评人员检查分析,对8支违反了比赛纪律的队伍进行了禁赛处置。

“强网杯”系列活动蓄势待发

线上赛的成功举办,拉开了第五届“强网杯”一赛、一会、一展系列活动的序幕,成功晋级的32支精英战队将于7月10日-11日,在线下赛的舞台上角逐冠军宝座和百万奖金。期间还将同步组织开展强网论坛、网络安全先进技术成果展、“强网初心”红色故事汇、强网科普等系列活动,多维度大规模促进全民科学普及、开展群众性“四史”教育活动,向建党百年献礼。

接下来,作为“强网杯”品牌的系列赛事,精英赛、人工智能挑战赛和青少年专项赛也将相继启动,全面助力人才培养、技术创新、产业发展的良性生态构建。

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

CarPlay 新增两款音频应用,让你的旅途更精彩

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

谷歌免费存储空间调整:未绑定手机号仅享5GB

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

NHS 医护人员对卫生服务网络安全措施缺乏信心

薄弱的网络防御正在暴露关键基础设施的风险 - 企业如何主动防范精明的攻击者以保护我们所有人

数千个已私有化的 GitHub 代码库仍可通过 Copilot 访问

Check Point 联合创始人谈 AI、量子计算和独立性

Versa 声称重新定义企业级 SASE

告别分享个人手机号的烦恼:Surfshark 虚拟号码服务全新上线

苹果目前仅能检测出一半被感染 Pegasus 间谍软件的 iPhone

网络监测中心设立"飓风等级制"评估网络攻击损失

Deepwatch 收购安全情报公司 Dassana,加强 AI 驱动的网络安全防御能力

AI 驱动的关键基础设施网络安全创企 Dream 以 11 亿美元估值融资 1 亿美元