“一招控场”安全运营,新华三北望新一代态势感知系统发布

为应对日益复杂的网络安全态势,提升行业用户整体安全运营能力, 3月31日紫光股份旗下新华三集团正式发布“北望”新一代态势感知系统,充分释放“云智原生”的全栈技术能力,大幅提升在不同场景下,针对已知及未知威胁的分析、预警、溯源及处置能力,构建全局视角的业务安全运营平台。

依托新华三集团云网安一体化的主动安全能力,“北望”新一代态势感知系统搭载业内首个UMA统一元数据引擎,以及AI降噪、AI制导等创新自研技术,能实现对各类网络安全问题的全息感知、精准决策和协同自愈,从而构建起完善可靠的安全防护体系,为百行百业数字化转型构筑安全基石。

深度覆盖行业场景,安全运营能力再跃升

当下,全球进入数字驱动新经济发展的新周期,大数据、AI、区块链、物联网等技术成为推动生产、生活方式变革的重要引擎。但伴随而来的泛在连接,使得传统网络安全保障体系收效渐微。行业亟需一个功能更加强大、更加智能主动的网络态势“控场”者,以应对数字化带来的变革和挑战。

信通院安全所测评中心副主任、高级工程师徐杨表示,未来网络安全防护的发展将走向“快、准、有效”,如何保证第一时间精准发现、定位威胁并有效处置,同时举一反三排查潜在风险,将成为网络安全建设的重中之重。在此背景下,新华三集团“北望”新一代态势感知系统应运而生。该系统面向“业务化、实战化、运营化、智能化、自动化、SaaS化”六大战略方向,并以DevSecOps安全开发运营管理流程平台等八大基础平台和诸多创新技术为支撑,为其构建起全息感知、精准决策、协同自愈三大核心能力,覆盖N个业务场景,实现了安全防御和运营管理水准的全面跃升。

三大“杀手锏”,安全态势全面“控场”

作为业内首个态势感知国家标准,《网络安全态势感知技术标准化白皮书》在落地建设方面拥有重要的指导意义。全国信息安全标准化技术委员会WG5信息安全评估工作组副组长顾健表示,实现安全态势的全面掌握,需要满足数据来源丰富、感知流程规范自动化、感知结果丰富等诸多要求,并且具备预测能力,并能够广泛适用各种行业,各种规模。

对此,新华三集团“北望”新一代态势感知系统以全息感知、精准决策、协同自愈三大“杀手锏”充分满足标准要求。

● 在全息感知层面:“北望”新一代态势感知系统基于新华三的UMA统一元数据引擎,全面洞察网络空间的流量、应用、业务、风险、资产、攻击、身份、行为、资源使用等状态变化,构建出全时空、全状态、全关系图谱,形成完整资产画像和用户画像,从而解决碎片化信息获取难题,形成感知优势。

● 在精准决策层面:“北望”依托细粒度事件序列、攻击源目二部图网络,能够对攻击方式和攻击节点进行精准预测,同时利用AI降噪和AI制导技术,在大幅提升处理效率的同时将安全事件误报率控制在1%以下,实现了事件决策能力升级。此外,通过知识图谱技术和自研时空溯源引擎,快速锁定并消除感染源,实现了溯源分析能力的大幅强化。

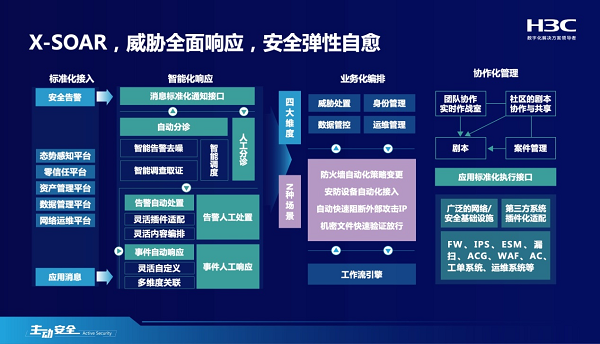

● 在协同自愈层面:“北望”基于业务场景打磨推出X-SOAR引擎,该引擎可以对来自各平台的消息和告警进行事件去噪、智能合并等分诊操作,最后利用网络、安全基础设施自动化执行,实现内网安全弹性自愈。

基于以上维度的升级优化,“北望”新一代态势感知系统能力得以全面提升,伴随着其在更丰富场景中得以实践和沉淀,将更大程度上提升对网络安全的全局把控能力,确保数字化安全底座的平稳、有序运行。

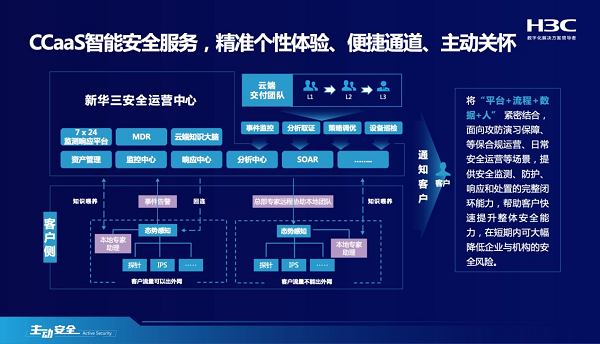

加码CCaaS智能安全服务,构建客户态势感知能力抓手

伴随各行业业务上云,网络攻击日趋多样化、复杂化,如何有效构建安全保障体系成为全行业关注的重点。对此,新华三集团北望新一代态势感知系统推出了CCaaS智能安全服务,即由安全运营中心云端专家利用云地协同通道提供会诊、MDR托管等服务,帮助客户做好重大节点的系统安全加固和安全事件运维工作。

客户遇到紧急突发事件时,可一键接入安全运营中心寻求专家帮助,同时还能将安全运维服务托管到安全运营中心,由云端运营中心进行7*24小时托管运维。在态势感知平台和智能安全服务的双重加持下,客户将构建起态势感知能力和安全技术的有力抓手,显著提升网络安全防护的效率和水准。

新华三集团安全产品线研发副总裁、安全软件产品总经理韩小平在发布会上表示,依托北望态势感知系统构建的网络安全解决方案已经在教育、交通、党政等多领域实现落地。未来,新华三将持续秉持“云智原生”战略推进“数字大脑”实践落地,依托技术创新优势构建网络安全壁垒,助力百行百业加快数字化转型进程。

来源:业界供稿

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

CarPlay 新增两款音频应用,让你的旅途更精彩

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

谷歌免费存储空间调整:未绑定手机号仅享5GB

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里