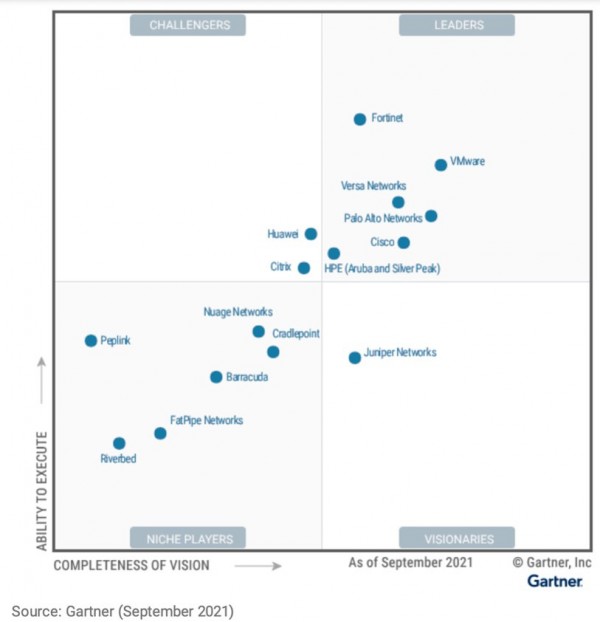

Aruba再度入选Gartner广域网边缘基础设施魔力象限领导者

Hewlett Packard Enterprise(NYSE: HPE)旗下公司Aruba日前宣布,HPE(Aruba和Silver Peak)再次被评为2021年度Gartner 广域网边缘基础设施魔力象限领导者。这是HPE(Aruba和Silver Peak)连续第四年进入全球最具权威的IT研究与顾问咨询公司Gartner发布的魔力象限报告的领导者行列。

自该报告出版四年以来,Aruba是仅有的两家连续四年被评为领导者的厂商之一,这进一步证实了Aruba收购Silve Peak的合理性。Gartner认为,正是由于对Silver Peak的收购,基于客户咨询和在线会话分析,HPE(Aruba和Silver Peak)展现了很高的市场可见度。

Gartner发布的魔力象限(MQ)报告通过对厂商进行可视化简介、深入分析和给出可操作建议来提供关于一个市场的发展方向、成熟度和参与者的洞见。在广域网边缘基础设施魔力象限报告中,Gartner以“愿景完整性”和“执行力”为主要标准评估了15家厂商。该报告不仅包括了对各个厂商的简介,而且对厂商的行业优势和客户们应注意的事项都进行了评估。

Gartner表示:“广域网边缘基础设施市场持续从用于连接分支机构和数据中心的传统分支路由器(在多协议标签交换实现中通常称为‘客户边缘路由器’)向支持更加分散的架构和云工作负载的软件定义广域网(SD-WAN)迁移。软件定义广域网(SD-WAN)正广泛取代边缘路由器,并新增了在多个链路中具有应用感知能力的路径选择、集中编排和本地安全功能,以及其他的性能优化功能(例如WAN优化)”。

此外,Gartner在今年的报告中还更新了几项战略规划假设,其中包括:“ 到2024年,超过70%的软件定义广域网(SD-WAN)客户将实现安全接入服务边缘(SASE)架构,而2021年这一比例为40%。”

Aruba作为有线和无线网络领域的领导企业,也在积极布局SASE,今年4月,Aruba ESP推出一系列跨产品的、从边缘到云安全功能的集成及多项创新改进,包括ClearPass Policy Manager安全网络访问控制平台与Aruba EdgeConnect SD-WAN边缘平台集成,以及 Aruba 威胁防御与 EdgeConnect 平台集成,并拓展了Aruba ESP的多供应商安全合作伙伴生态系统,进而允许企业客户自由部署其选择的同类最佳的云交付安全接入服务边缘 (SASE) 安全组件。

Aruba通过SASE,将零信任安全和SD-WAN结合起来。SASE融合了网络技术和网络安全技术,并通过云进行交付,从而简化了架构并使其迅速扩展,企业客户能够从边缘到云应用基于身份的细颗粒度安全策略,以便安全地连接并保护用户和设备。

Aruba首席产品和技术官David Hughes表示:“无论企业处在数字化转型过程中的哪个阶段,只要借助Aruba的软件定义广域网(SD-WAN)产品组合,所有行业不同规模的企业都能满足多种用例的要求。连续四年被评为领导者进一步证实了我们边缘到云的理念不仅切实可行,而且能支持企业在瞬息万变的商业环境中获得竞争优势。”

Aruba中国区总裁谢建国也表示:“Aruba专注于网络解决方案创新,希望成为行业用户数字化转型的合作伙伴,凭借对客户需求的深入探索和对产品创新的不懈追求,我们得到行业的认可和客户的信任。未来,Aruba会持续关注网络技术发展的前沿趋势,不断完善各种解决方案,帮助客户更从容地应对数字化转型时代的挑战。”

点击下方免费阅读Gartner WAN边缘基础设施魔力象限报告

好文章,需要你的鼓励

亚马逊推出Alexa网页版:生成式AI助手的新选择

亚马逊在CES期间宣布推出Alexa.com网站,用户可像使用其他AI聊天机器人一样与Alexa交互。经过数月早期体验,Alexa+已获得数千万用户。新网站支持语音和文本交互,需登录使用以确保跨设备功能连续性。76%的Alexa+交互为独特任务,包括智能家居控制和第三方集成。Alexa+兼容七年来的设备,正式版将收费每月20美元或包含在Prime会员中。

UCSD团队打造终极仿真世界:让AI智能体在虚拟城市中自立更生的惊人实验

SimWorld是由UCSD等多所顶尖院校联合开发的革命性AI仿真平台,基于虚幻引擎5构建了具备真实物理规律的虚拟城市环境。该平台支持无限扩展的程序化世界生成和自然语言交互,让AI智能体能够在复杂环境中学会生存、合作和竞争,为通用人工智能的发展提供了前所未有的训练平台。

Plaud推出可穿戴AI记录设备NotePin S,CES 2026记者新利器

AI笔记公司Plaud在CES 2026推出新款可穿戴设备NotePin S,可夹在衣领、戴在手腕或挂在脖子上记录对话。该设备通过蓝牙连接手机,配备双麦克风,录制范围约3米,支持一键高亮标记重要时刻。同时发布的还有Plaud Desktop桌面AI记录工具,可原生捕获线上会议内容,无需机器人加入通话。两款产品将所有笔记、会议和对话整合到统一平台管理。

浙江大学团队提出C2DLM:让AI推理更像人类思维的全新语言模型

浙江大学联合华为提出C2DLM,这是一种因果概念引导的扩散语言模型,通过自动提取因果关系并融入注意力机制来增强AI推理能力。相比传统方法,C2DLM在推理任务上平均提升1.31%-12%,训练效率提高3.2倍,为解决语言模型推理能力不足开辟了新路径。

亚马逊推出Alexa网页版:生成式AI助手的新选择

Plaud推出可穿戴AI记录设备NotePin S,CES 2026记者新利器

机器人初创公司推出现实版瓦力机器人及其他伴侣产品

VisIC宣布完成2,600万美元B轮融资

CES 2026 | AMD扩张“边缘统治力” “芯片级异构”塑造汽车、工业边缘应用“新法则”

CES 2026 | NVIDIA新风向: Rubin平台面市 ,系统级“AI工厂”成型,物理AI加速落地

英伟达Vera-Rubin平台推出前六月已淘汰现有AI硬件

英特尔推出首批18A工艺制程的Core Ultra处理器

Rokid在CES 2026推出无屏AI智能眼镜

英伟达物理AI模型为新一代机器人铺路

微软发布 GitHub Copilot 的 C++ 代码编辑工具

至顶AI实验室硬核评测:戴尔Precision 5690移动工作站,部署DeepSeek+LobeChat打造个人超级智能体