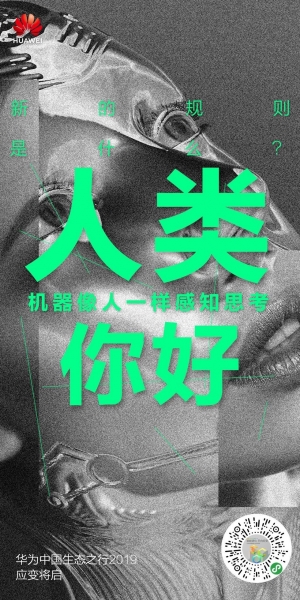

这一次,新的规则是什么?

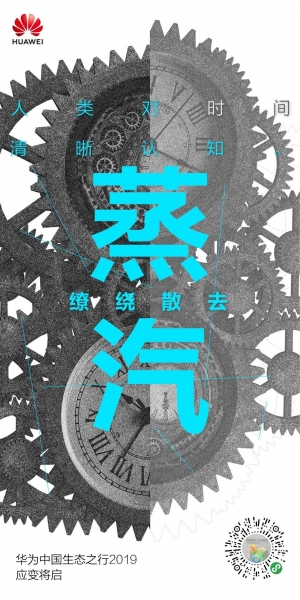

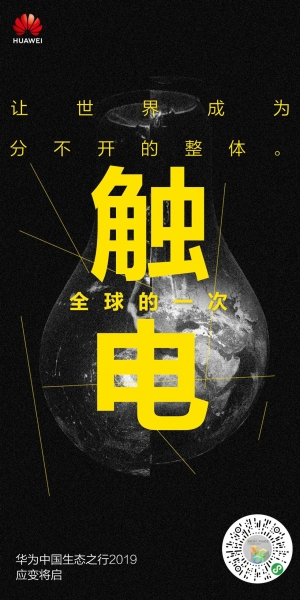

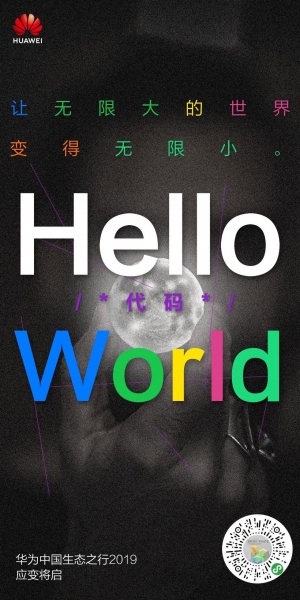

华为中国生态之行2019,4月,即将启动。

好文章,需要你的鼓励

东芯股份赴香港筹 H 股,存储芯片公司的海外前台先行

今天讲的出海案例是东芯股份,一家做 NAND、NOR、DRAM 的存储芯片公司,正筹划赴香港发行 H 股并搭建境外投资治理框架。

阿里云团队破解AI训练“多目标困境“:让大模型同时学会准确答题又懂得简洁表达

阿里云团队提出DVAO方法,通过动态方差自适应权重解决大模型多目标强化学习中的训练不稳定与目标割裂问题,在数学推理和工具调用任务上全面超越现有基线。

EcoFlow限时48小时促销活动:12.2千瓦时储能电站套装优惠

EcoFlow将RV季节促销与EcoCredits月度活动合并,推出48小时限时闪购。12.2kWh DELTA Pro Ultra便携式储能电站搭配额外电池及免费小推车,售价5599美元,比亚马逊价格低400美元。该套装官方建议零售价9397美元,当前折扣力度达36%,为品牌直销历史最低价之一。电站最大输出功率7200W,可扩展至21.6kW,容量最高支持扩展至90kWh,具备IP54防尘防水等级。

2026-06-01

华中科技大学等十六所顶尖机构联手发布:AI能替代科学家做研究吗?一份来自2026年的答卷

这篇由十六所顶尖机构联合发布的综述研究(arXiv:2605.23204)提出了AI辅助科研自动化的五层框架,系统梳理了当前AI在科研各阶段的真实能力边界与核心局限。

最新文章

Meta正在研发AI智能挂坠,计划年内启动测试

iOS 27视觉智能新期待:为"提醒事项"赋能

AI能为澳大利亚养老行业带来更多人情味吗?

东芯股份赴香港筹 H 股,存储芯片公司的海外前台先行

EcoFlow限时48小时促销活动:12.2千瓦时储能电站套装优惠

Beats新款头戴耳机曝光:全新设计与粉色配色亮相

NextThere:一款为公共交通出行提供深度数据洞察的独立应用

软银宣布将在法国投资高达750亿欧元建设数据中心

Juiced Bikes电动摩托车正式在美开售,性价比剑指行业格局

量子计算时代将至,企业安全防护远未做好准备

AI虚拟模特正在重塑时尚行业的未来

Apple TV 4K即将创下无人乐见的销售周期最长纪录

相关文章

邮件订阅

AI启示录