华为云亮相第十六届中国国际软交会

第十六届中国国际软件和信息服务交易会(以下简称“中国软交会”)于2018年6月12日-15日在大连世界博览广场隆重召开。大会以“软件定义智能新时代”以主题,汇集了700多家参展商,涵盖了人工智能、大数据、云计算、物联网等领域,旨在通过本次大会全方位地展现信息技术产业的核心价值和作用,把最先进的技术解决方案和创新产品最大限度地融合到全产业链条中。本次软交会,不仅是全球IT行业的展示平台,更是业界精英先进思想的碰撞。

华为以“华为云,有技术,有未来,值得信赖”为主题亮相本届软交会,同时承办了华为云分论坛。会上,华为辽宁企业业务副总经理李信在致辞中表示:云服务已成为智能社会的基本商业模式,一方面,云在塑造一切,所有行业都在因云而变;另一方面,一切又在塑造云,各行业的关键业务不断驱动云的演变。华为在提供云服务、开放云上能力、携手伙伴助力客户形成新的商业和服务模式这三个方面均有建树。华为将坚定不移打造一个开放、可信的公有云平台,并将携手整个行业的伙伴,建设一个繁荣共赢的公有云生态,助力客户获得商业成功。

华为辽宁企业业务副总经理李信

随后,华为Cloud BU东北区运营总监高晓东进行了“华为云,联接企业现在与未来”的主题演讲。他谈到,华为云是领先的云服务品牌,通过在芯片、硬件、操作系统、数据库等能力上的深厚技术积累,以及在软硬件协同一体化等方面的优势,持续为企业客户提供安全可信、稳定可靠、可持续发展的云服务。面向大中型企业,华为云帮助他们解决云转型中的困难,更好地把握未来,引领数字化转型;面向中小型企业,华为云帮助他们应对互联网业务云基础设施2.0时代的新挑战,陪伴他们成长。华为云将恪守自己业务边界,上不做应用,下不碰数据,不做股权投资,做智能世界的黑土地,与合作伙伴、客户一起来努力前行,通过持续创新,创造价值,不断探索智能社会行业变革。

华为Cloud BU东北区运营总监高晓东

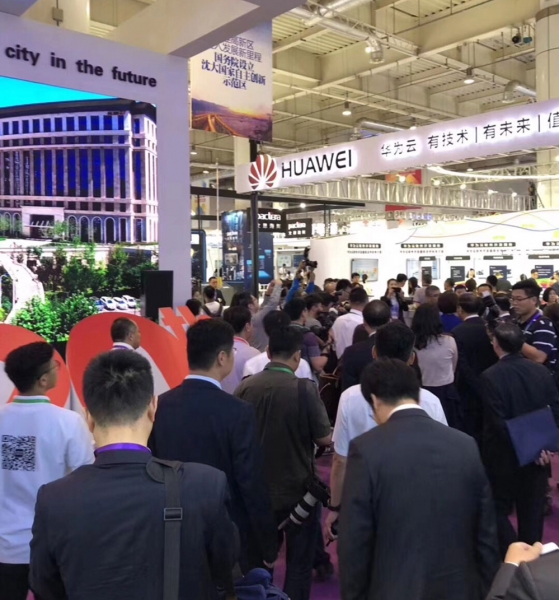

在展厅中,华为联合合作伙伴展示了华为云软件开发服务,华为云智能制造服务等创新解决方案,其中华为云软件开发服务是基于华为研发30年成功实践经验,通过云服务的方式面向中小软件企业、软件外包企业、双创企业、互联网企业、高校和广大的软件开发者提供一站式云端DevOps平台。开发团队基于云服务的模式按需使用,随时随地在云端进行项目管理、配置管理、代码检查、编译、构建、测试、部署、发布等;软件开发将更加简单高效,开发者能够专注快速创新和应对永无止境的需求变化。个人和团队的交付能力、效率大幅提升,帮助提升企业竞争力。

与会嘉宾参观华为展台

华为云智能制造解决方案是华为基于自身智能制造转身经验,携手制造行业解决方案生态伙伴,以云服务为底层基础,发挥华为在IaaS层和PaaS层的技术优势,为工业制造企业打造全面、高效的智能制造云生态环境,提供云端一站式智能升级服务,覆盖工业制造企业全链条流程,包括:产品设计研发、生产管理、供应链管理、销售管理及售后服务等业务环节,拉通制造产业协同,助力制造产业升级。

中国软交会华为展台

大连市一直把软件和信息技术服务业作为其支柱产业,经过多年发展,已经成为中国软件和信息技术服务业的重点城市之一。目前,华为云已经服务大连本地软件企业近千家,并为大连理工大学、大连海事大学等本地多家高校提供服务,将华为云软件开发服务作为学生实践平台。面向未来,华为将持续加强云服务的战略投入,聚焦打造开放、安全、可靠的云基础设施服务,助力各行业加速实现数字化转型。

好文章,需要你的鼓励

苹果48GB M5 Pro MacBook Pro创历史新低,直降300美元

B&H近期对多款M5 Pro MacBook Pro机型推出300美元优惠。14英寸M5 Pro版本(48GB内存+1TB固态硬盘)现售价2299美元,较原价2599美元节省300美元,且该配置在亚马逊无法购买,折扣机会更为难得。此外,16英寸M5 Pro版本(64GB内存+1TB固态硬盘)同样享有300美元折扣。B&H在多款高配MacBook机型上的定价已低于亚马逊,是近期可找到的最优价格。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

Insta360推出GO 3S复古套装,将现代4K运动相机与胶片时代美学结合。套装核心仍是仅重39克的GO 3S,新增复古取景器、胶片风格滤镜、NFC定制外壳及可延长录制时长至76分钟的电池组。复古取景器模仿老式腰平相机设计,鼓励用户放慢节奏、专注构图。相机内置11种色彩预设及负片、正片等滤镜,同时保留FlowState防抖、4K拍摄及10米防水能力,面向热衷复古影像风格的年轻创作者。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

CarPlay 新增两款音频应用,让你的旅途更精彩

Insta360 GO 3S复古套装:怀旧美学与4K影像的融合

谷歌免费存储空间调整:未绑定手机号仅享5GB

美国三大运营商携手卫星技术,向信号盲区宣战

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里