第一个开源的具有实时对话能力的多模态模型:Mini-Omni

Mini-Omni是清华大学启元实验室开源的多模态模型,具备实时语音到语音的对话能力,无需额外的ASR或TTS模型。它能够边思考边说话,支持流式音频输出,并能通过'Any Model Can Talk'方法为其他模型添加语音交互能力。

用 Llama3 70B 打造你的AI投资助手

StockBot是一款AI金融分析机器人它集成了六种@tradingview小部件,包括市场热图、财务数据、股票历史价格、蜡烛图、热门新闻和股票筛选器。

英伟达下一款Linux驱动程序开源了,但又没完全开源

对于英伟达Grace Hopper以及英伟达Blackwell等前沿平台,您只能使用开源GPU内核模块。这些平台不支持专有驱动程序。

META 的全息眼镜将颠覆数字化互动方式!

当被问及 Meta 最令人兴奋的未来产品时,扎克伯格推荐了一款智能眼镜,该眼镜配备了摄像头、麦克风、扬声器和全视场 (FOV) 全息显示屏。

AI治理工作中的四大重要经验

总部于位于得克萨斯州奥斯汀的软件公司Planview从18个月前起,就开始使用生成式AI提升生产效率。在此期间,他们还尝试将生成式AI整合进自己的产品当中,构建起可供用户交互的copilot服务,用于支持战略投资组合与价值流管理。

一周年 英特尔中国开源技术委员会硕果累累

在2024年这个充满活力的科技年份,英特尔中国开源技术委员会迎来了它成立一周年的关键时刻。这一年里,该委员会不仅加深了与中国开源社区的合作,还通过创新应用和战略规划,推动了开源技术在中国乃至全球的快速发展。

CIO指南:采用开源生成式AI需要注意的十件事

企业应该知道该怎么做才能确保他们使用的是经过适当许可的代码,如何检查漏洞,如何保持所有内容都已经修补并保持最新状态。

IBM将量子软件包Qiskit扩展到全技术栈

IBM今天宣布,将扩展其开源量子软件工程工具包Qiskit,覆盖整个软件开发栈,更好地帮助开发人员为研究和企业应用的量子处理器构建实用的解决方案。

Red Hat阐述和开源社区共同发展AI模型的愿景

Red Hat近日提出了对生成式AI的看法,概述了一种信念:这个正炙手可热的技术,其未来将取决于开源软件以及让用户社区支持它的能力。

重磅!Llama-3,最强开源大模型正式发布!

Meta发布开源大模型Llama-3,具有80亿和700亿参数版本,性能在推理、数学、代码生成等方面有显著提升。Llama-3采用了分组查询注意力、掩码等技术,提高了计算效率。预训练数据达15T tokens,支持多语言。测试显示Llama-3性能超过多个知名模型。

实现开源软件安全,开发人员需要考量的三大关键因素

网络威胁变幻莫测,最近备受瞩目的开源软件安全事件(如 log4Shell、Solar Winds、Colors and Fakers 等)及其对全球数以千计公司造成的灾难性影响,凸显了企业目前在强化数字环境方面所面临的挑战。

Cohere发布RAG增强版大模型并开源权重,支持中文、1040亿参数

据悉,Command R+有1040亿参数,支持英语、中文、法语、德语等10种语言。最大特色之一是,Command R+对内置的RAG(检索增强生成)进行了全面强化,其性能仅次于GPT-4 tubro,高于市面上多数开源模型。

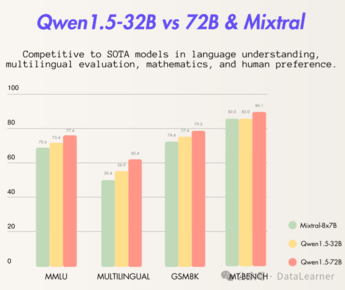

高产的阿里!Qwen1.5系列再次更新:阿里开源320亿参数Qwen1.5-32B,评测超Mixtral MoE,性价比更高!

阿里巴巴开源了320亿参数的大语言模型Qwen1.5-32B,性能略超Mixtral 8×7B MoE,略低于720亿参数的Qwen-1.5-72B。Qwen1.5-32B具有高性价比,显存需求减半,适合更广泛使用。模型在多项评测中表现优秀,特别是在推理和数学方面。支持32K上下文长度,以通义千问的开源协议发布,允许商用。

英特尔张开双臂,欲借开放硬件吸引开发人员

英特尔正努力对外发布尚在开发的硬件,同时辅以对开源的高度重视,希望借此将自身与竞争对手区分开来、吸引更多开发人员使用其云方案。

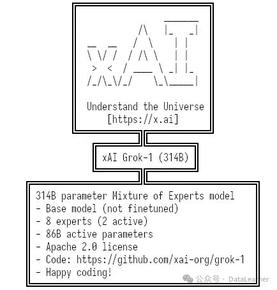

600GB显存才能拉起来的Grok-1不太惊艳!马斯克大模型企业xAI开源Grok-1,截止目前全球参数规模最大的MoE大模型!

马斯克旗下大模型公司开发的Grok-1大语言模型已开源,采用Apache2.0协议。Grok-1是一个混合专家架构模型,参数总数3140亿,每次推理激活860亿。虽然在MMLU和GSM8K评测中表现不错,但与同类模型相比资源消耗大而收益不显著。开源的仅为推理代码,训练基础设施和tokenizer的特殊token作用未透露。

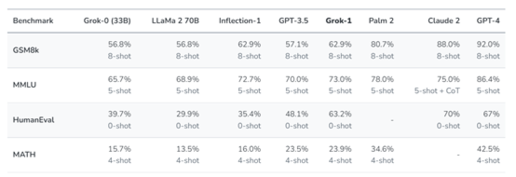

马斯克将在本周,开源类ChatGPT产品Grok

马斯克宣布将开源其公司xAI发布的生成式AI产品Grok,一款类ChatGPT产品,提供文本、代码生成等功能,性能超GPT-3.5但弱于GPT-4。Grok-1在多个测试平台表现优异,但仍有局限性,如需内容审核,无独立搜索能力。

DeepSeek-VL:深度求索的多模态大模型

DeepSeekVL是一款开源多模态模型,通过对训练数据、模型架构和训练策略的联合拓展,构建了7B与1.3B规模的强大模型。相关资源可通过论文链接、模型下载页面和GitHub主页获取。